原文:https://dougshapiro.medium.com/ai-use-cases-in-hollywood-362707e899f1

时间:2023年9月19日

作者:道格·夏皮罗(Doug Shapiro),独立顾问/咨询专家,BCG 高级顾问,前 Turner/WarnerMedia 分析师

翻译:Horace Lu

(注:键盘快捷键“w”或左侧菜单右上角按钮,可切换文章列表视图与大纲视图)

- 摘要

- AI 与生成式 AI 在好莱坞的应用

- 你的 2 亿美元究竟花在了哪儿?

- 简化版的制作流程

- 总体预算概览

- 当前的应用案例

- 这一切将发展到何种程度?

- 未来用例预测

- 摄影棚/外景拍摄的终结(End of the Soundstage/End of Shooting On-Location)

- 服装与化妆的终结(No Costumes or Make-up)

- 粗剪和视效的 AI 助手(First Pass Editing / VFX Co-Pilot)

- 表演替身(Acting Doubles)

- 满足电影/电视质量的文本转视频(Cinematic/TV- Quality Text-to-Video)

- 服务于故事初稿的定制化训练模型(Custom Training Models for First Pass Storytelling)

- 内容的新形态(New Types of Content)

- 成本可能大幅降低

- 好莱坞应该做什么?

- 我知道,这一切令人目不暇接

在过去的九个月里,我持续探讨了几种新兴技术,特别是人工智能(包括生成式人工智能)如何有潜力在未来几年内颠覆好莱坞,因为它们降低了制作高品质视频内容的门槛(详见文章 《电视启示录的四骑士》 和 《告别电视黄金时代,迎接无限电视的时代》)。简而言之,过去十年的影视行业主要受到内容发行方式颠覆式变革的影响,而未来十年则将主要受到内容创作方式颠覆式变革的影响。

这个总结虽然很精炼,但也带来了诸多疑问。比如,我在最近一篇文章中探讨了好莱坞可能被颠覆的速度与程度(《好莱坞的颠覆进程将如何展开?》)。

在本文中,我尝试回答另一系列问题:AI究竟将如何降低内容创作的门槛?影视生产过程中的哪些环节将受到最大的影响?哪些应用案例最有前途?节约成本的措施何时能够实现?目前哪些是可行的,未来又有哪些新动向?在这些技术降低入门门槛的情况下,传统的电影制片公司——也就是好莱坞——是否也能从中受益?

摘要

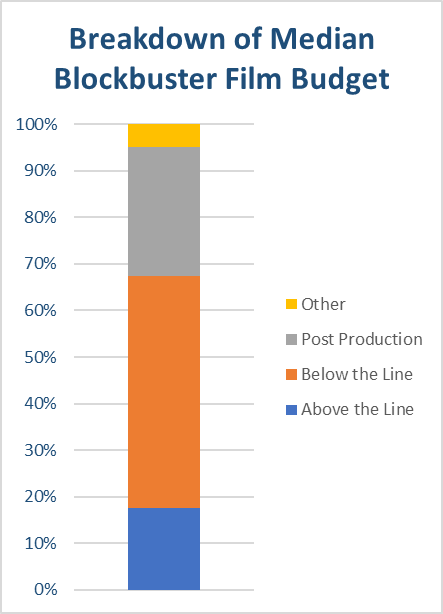

目前,大预算电影的制作成本中位数约为 2 亿美元,而高成本电视剧集每集的制作费用经常超过 1000 万美元。在这些成本中,大约 15-20% 用于“线上”(Above the Line, ATL)核心主创费用,50%用于“线下”(Below the Line, BTL)人员和制作费用,约 25-30% 用于后期制作(主要是视效)费用,其余则用于其他费用。总体来看,这些成本中大约 2/3 是劳动力成本。

虽然这个话题比较敏感,但随着时间的推移,基于生成式人工智能(Generative AI, GenAI,下文统称为“生成式 AI”)的工具有望替代(并威胁到)上述的大部分劳动力。

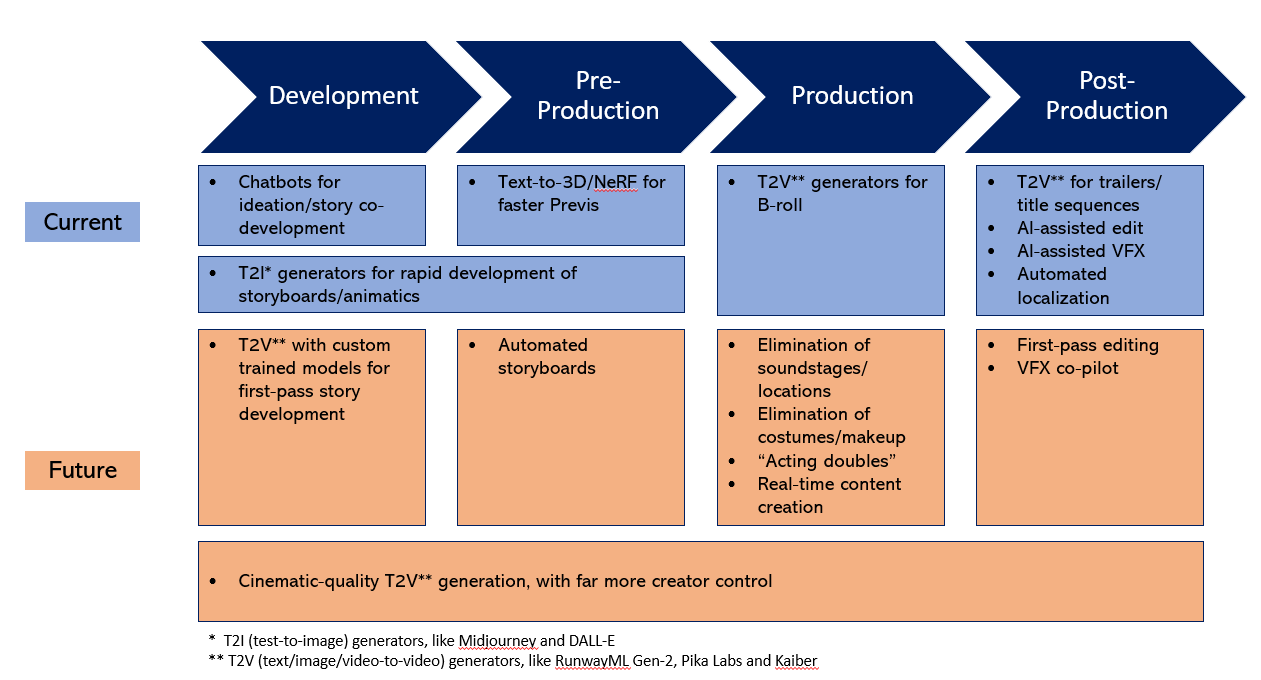

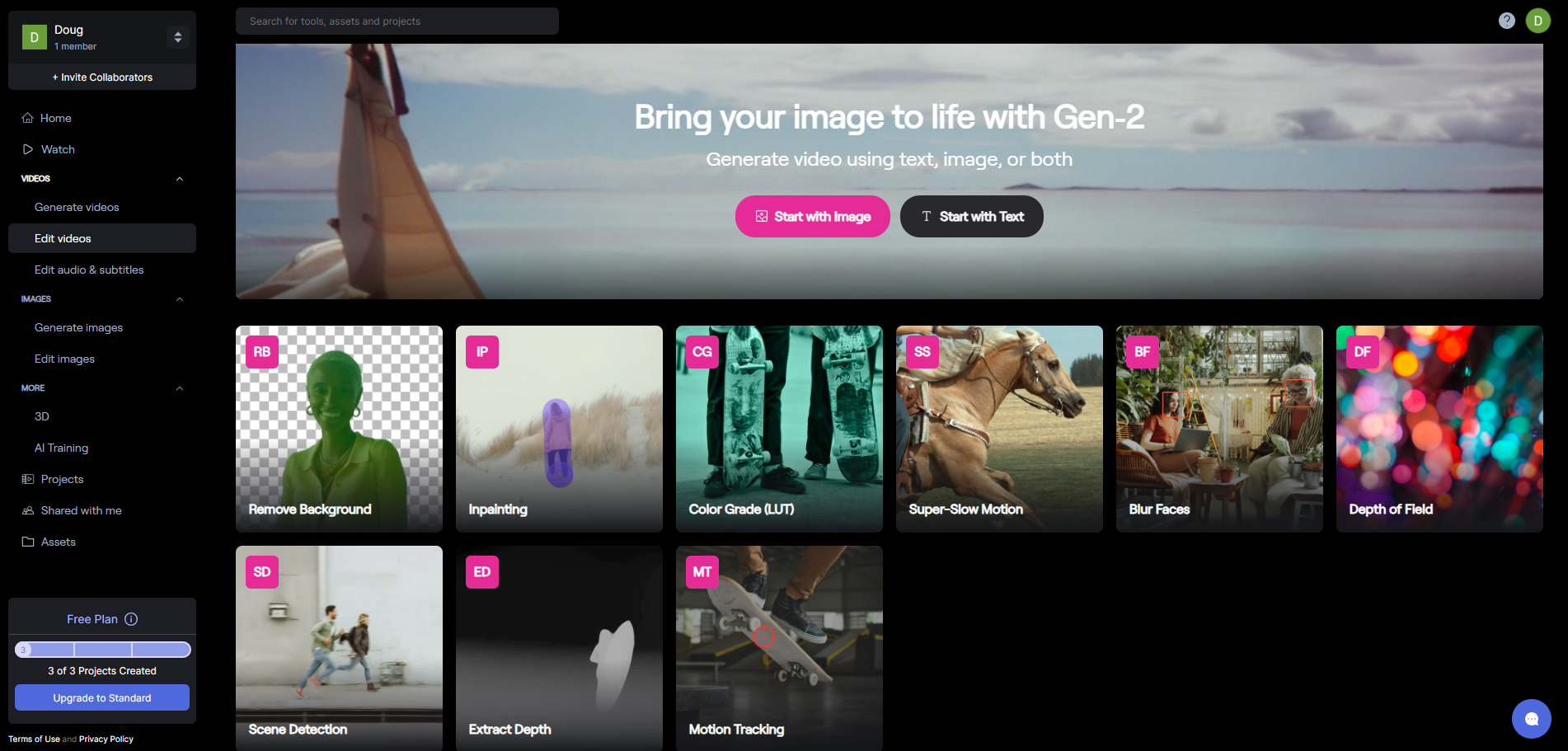

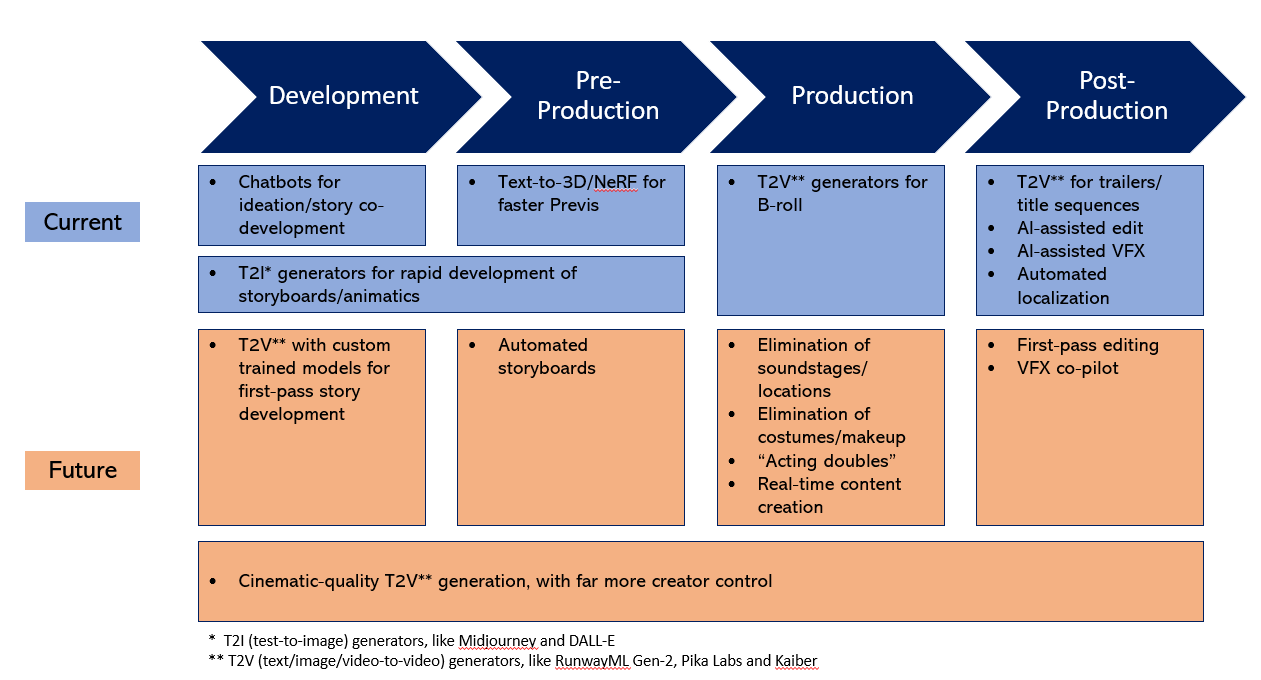

实际应用案例已经在影视制作的各个阶段逐渐出现,包括故事开发(story development)、故事板(storyboarding)和动态分镜(animatics)制作、可视化预演(pre-visualization, “previs”)、辅助镜头拍摄(B-roll)、剪辑(editing)、视觉特效(Visual Effects, VFX)和本地化服务(localization services)等。

这一趋势将如何发展?最终,生成式 AI 在制作过程中的普及将取决于消费者的接受程度,而非技术本身。

即便我们保守一些,假设影视制作永远离不开人类创意团队和真人演员,生成式 AI 的未来潜在应用场景仍然广阔,包括:淘汰实景拍摄和外景地;淘汰服装和化妆;担任粗剪和视效助手;为主演提供“表演替身”;更具电影感的文本转视频(text-to-video)生成器(提供更高分辨率、给创作者更多控制权);定制化训练的视频生成模型;以及内容创作的新形态。

所有这些用例都可能对制作成本产生深远的影响。随着时间推移,所有“非线上”费用的成本曲线(cost curve for all non-ATL costs)可能会与(使用计算机)计算的成本曲线(the cost curve of compute)趋于一致。

对于好莱坞而言,行业门槛的降低意味着竞争的加剧。虽然降低生产成本是一个积极因素,但它在应变管理(change management)方面也带来了严峻的挑战。好莱坞制片公司有两种选择,一种是先尝试将 AI 应用于非核心流程,另一种是设立秘密研发部门 [1],从零开始开发以 AI 为主导的内容。

AI 与生成式 AI 在好莱坞的应用

人工智能(Artificial Intelligence,AI,下文统称“AI”)在影视中的应用由来已久。例如,Adobe Premiere Pro 利用 AI 来自动化剪辑流程、制作字幕和标题、进行色彩校正。索尼则运用 AI 来实现摄影机的自动对焦。此外,像 ScriptBook 和 VaultAI 这样的服务,使用 AI 来分析剧本,并尝试预测其成功概率。Netflix 的技术博客 包含了一系列文章,介绍了其利用机器学习和计算机视觉技术的一些案例,例如自动为图像添加元数据标注、制作个性化缩略图、自动创建预告片等。

这些应用案例中的大多数是通过“判别式”AI 模型(“discriminative” AI models)实现的,这类模型可以学习数据与标签之间的关系。当收到新数据时,它们利用这些知识进行标注。一个典型的例子是,根据猫的图片训练的模型,能够识别出猫的图片。

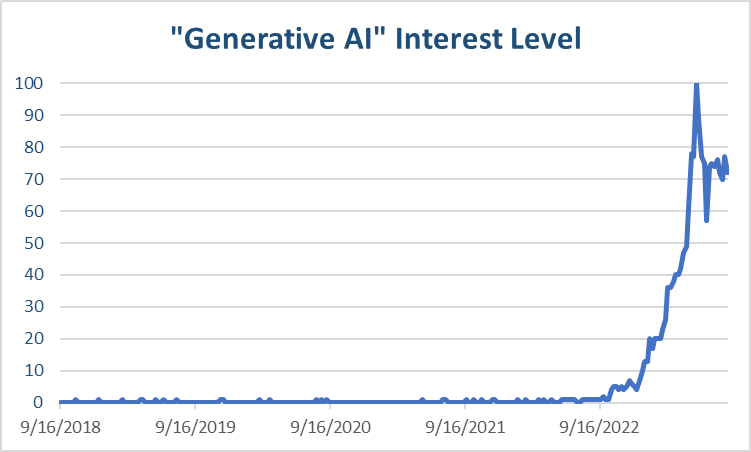

相比之下,生成式 AI 则相对较新。如图 1 所示,一年前几乎没有人听说过这个术语。不同于判别式模型,“生成式”(“generative”)模型学习非结构化数据中的模式,并且当出现新数据时,它们能够利用这些知识生成新的数据——无论是文本、音频、像素(用来创建图像或视频)还是体素(用来创建 3D 图像)。例如,GPT 3.5、4.0 等背后的 Transformer 模型,会为每个单词(即向量)分配一组数值,这些值描述了词与词之间的关系(相似或相关的词会有相似的向量)。当 ChatGPT 根据一组提示词(prompt)做出回应时,正是这些关系帮助它基于概率(probabilistically)预测接下来的单词。累积足够多的单词后,就能形成一个全新的段落。

这种称为“生成式 AI”的概念,即根据一定的约束条件(如提示词)来创造新的文本、图像、音频或视频,已在整个影视制作流程中得到应用。

然而,在深入探讨这项技术对生产成本的具体影响之前,我们需要先了解一下当前的影视制作流程,以及好莱坞是如何花钱的。

你的 2 亿美元究竟花在了哪儿?

在所有流行文化领域中,电影的预算是最公开且受到最严格审视的。当一部大制作电影上映时,其预算数额通常也会公开。举两个近期的例子,《阿凡达 2:水之道》可能是有史以来制作成本最高的电影,其制作成本据称超过 4 亿美元。而相对而言,制作成本更为“适中”的《芭比》据称耗资 1.45 亿美元。

维基百科,以及电影行业网站 The Numbers,常常提供电影预算的估计值。(值得一提的是,“制作成本”(prouction costs)指的是制作最终成片所需的费用,其中并不包括宣发(Prints and Advertising, P&A)费用,后者指的是电影的营销成本以及制作影院放映拷贝的成本,这些费用往往持平或超过制作成本。)随着近年来电视剧集预算不断增长,对电视剧集预算的估计也变得更加普遍。例如,据报道,《权力的游戏》最后一季每集的成本为 1500 万美元,而剧版《指环王》每集的成本据称超过 2500 万美元。

这些电影和电视剧集的预算估计值通常是粗略的(且未经片方证实),同时可能低估了实际的制作成本。但是,仅从表面价值来看,5000 万美元(用于像 《菲利普船长》这样的中等预算剧情片)、1 亿美元(用于 《疾速追杀 4》)或 2 亿美元(用于 《闪电侠》)的资金究竟花在了哪里?为了回答这个问题,我们需要简要了解一下影视制作的流程和不同的支出类别。

简化版的制作流程

这里我们以电影为例,因为它是一个独立项目。但需要指出的是,这些基本概念同样适用于电视制作。传统的电影制作流程通常按照四个相对有序的阶段进行:

前期开发(Development)。在这一阶段,一个项目不过是某人脑海中的初步想法。导演、制片人、编剧以及制片公司的开发团队首先会勾勒出一个概念(即梗概(synopsis)),接着制作更详细的故事大纲,然后编写初稿剧本。核心主创(如导演和演员)此时会同意参与项目,或称为“加盟”(attached)。开发团队和/或制片人在这个阶段也会对预算进行非常粗略的估计。在开发期间,制片人或公司可能会选择购买一个项目的“优先购买权”(“option” the project),即购买“优先获得版权的选择权”[2]。这个阶段可能持续数月甚至数年,被称为“开发地狱”[3]。

前期制作(Pre-Production)。项目一旦得到批准(即获得“绿灯”)并融资到位,前期制作阶段便会启动。这是真正开始大量投入资金的阶段。这一阶段包括正式选定和签约核心主创(也称为“线上”人员,后文将详述),聘请剧组工作人员(即“线下”人员),剧本最终定稿,制作故事板或动态分镜,有时还包括可视化预演(即对每个镜头制作详细的三维预演片)、设计和搭建布景、制作比例模型(scale models)和服装等。同时,制片和财务团队也会制定详细的拍摄计划和预算。这一阶段的目标是尽可能地缩短拍摄时间。

现场制作(Production),或称“主体拍摄”(Principal Photography)。正如其名,这一阶段是电影拍摄的主要时期。此阶段还会包括机械或“实体”特效(Special Effects, SFX),如受控爆炸、汽车追逐、模型使用等。

后期制作(Post-Production)。这一阶段包括视效(VFX)工作,如制作计算机生成图像(Computer Generated Imagery, CGI),并将其合成到实拍画面中。如有必要,还会进行补拍。此外,该阶段还涉及剪辑、后期声音(音效)制作、添加字幕,并将所有元素(包括实拍画面、CGI、模型、声音、转场、字幕/标题等)“渲染”为最终画面,即“成片”(final pixel)。

总体预算概览

逐项列出的电影预算可能会有超过 100 页之多,其中详细记录了每一项开支。大多数预算中都会包含一张“预算总表”(topsheet),它将开支划分为几个主要类别,这些类别并不严格对应于上文提到的制作过程的各个阶段:

“线上”(Above the Line, ATL) 费用涵盖了所有被视为足够重要的位于“线上”的主创,其中包括制片人、导演、编剧、演员、特技演员,以及他们的差旅和生活费用(如交通、住宿、饮食和安全),此外还包括为制作该项目所获取的任何版权的费用。

“线下”(Below the Line, BTL) 费用则包括制作中涉及的其他所有人员。具体来说,包括制片团队(如制片主任和副导演)、选角导演、摄影组(包括摄影指导、摄影助理、器材租赁费)、布景设计与搭建(亦称为“艺术设计”)、实体特效(SFX,区别于 VFX)、场地费用、电力与照明、音效、服装、妆发、机械师与场工(负责搭建支撑摄影机和灯光的器械的人员),以及上述“线下”人员的差旅和生活费用。

后期制作 费用,包括前文所述的所有后期制作活动的相关开支。

“其他” 这一类别包罗万象,涵盖了保险、现场宣传、幕后花絮、可能的融资成本、其他行政费用等。

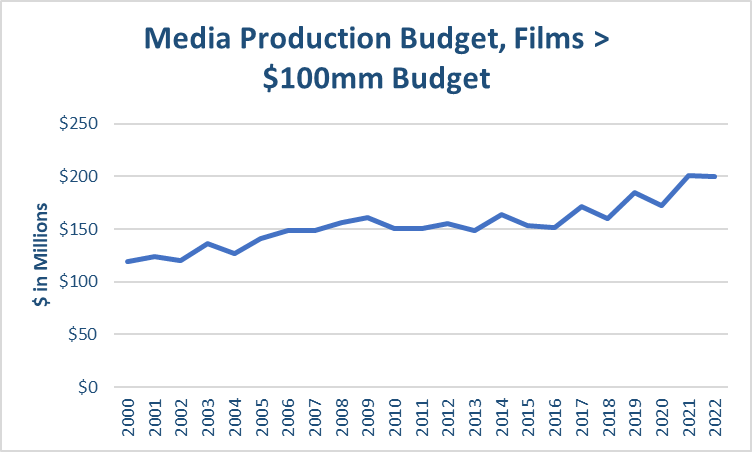

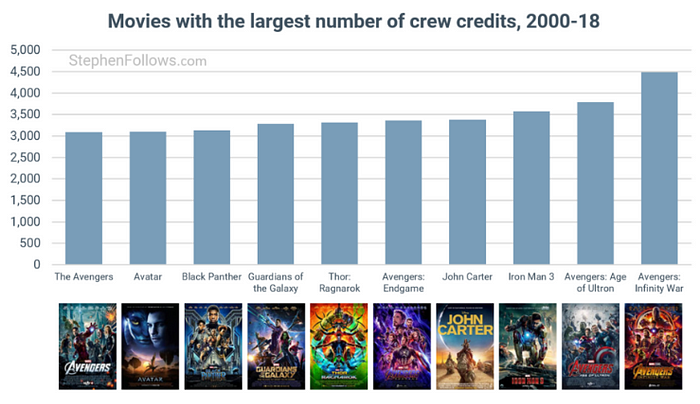

电影行业分析师 Stephen Follows 曾撰写了一篇很棒的文章,详细分析了各种预算规模项目的制作成本。但在我们的讨论中,我将重点关注开支最大的一部分,即大制作电影。正如图 2(也来自于 Follows 的文章)所示,这类电影的预算中位数目前约为 2 亿美元。

根据我与一些制片人的交流,预算的分配情况大致如图 3 所示,这与 Follows 的估计大致相符。大约半数的预算用于“线下”的各种职位,25-30% 用于后期制作(其中大部分是视效),大约 15-20% 用于“线上”主创(这是在考虑额外利润分成之前的情况),剩余的则是其他费用。

当我们开始探讨潜在的成本节约可能时,有两个相关的重要观点:

在这些大预算影片中,视效的平均支出大约是 5000 万美元。但在某些制作(例如特效密集的超级英雄电影)中,视效成本可能高达 1 亿美元。以《阿凡达:水之道》为例,其视效成本无疑超过了这一数额;该片 98% 的镜头都需要应用视效。

此外,这些开支中的大部分是劳动力成本。让我们再看一下图 3。“线上”成本的绝大部分是劳动力成本,包括制片人、导演和演员;“线下”成本中大约 60% 是制作团队的费用,如制片人员、摄影组、道具制作团队和化妆师;后期制作成本中大约有 50-60% 实际上是劳动力成本,包括视效艺术家和声音工程师;甚至在“其他”类别中,也有大约一半的成本是劳动力成本。总体来看,劳动力成本可能占到整体成本的 2/3。

为了进一步强调这一点,图 4 展示了 Follows 的另一项分析。尽管这些数据有些陈旧,但劳动密集型的电影会雇佣成千上万的人员。据统计显示,《复仇者联盟:无限战争》的制作团队达到了 4500 人。如果把外包团队(包括视效公司)也算进来,《阿凡达:水之道》的人员数量可能比这还要多。电视剧集制作同样如此,IMDb 上列出的参与《权力的游戏》全八季制作的人员超过了 9000 人。

接下来,我们来看看生成式 AI 的应用案例,以及它们可能如何影响这些成本。

当前的应用案例

在影视制作领域,AI 和生成式 AI 的应用案例每周都在不断涌现。它们主要分为两大类:

合成创造工具(tools that synthetically create something),这类工具能合成创造各种事物(如人物、想法、面孔、动物、布景、环境、声音、服装、化妆、音效等),从而减少对这些事物的物理或自然形态的依赖。

自动化工具,用于简化当前劳动密集且成本高昂的任务。

以下是一些目前已经可行,或即将实现的,在制作过程中价值最高的应用案例:

前期开发阶段

故事开发(Story Development)

此部分包括了通用文本生成器(如 ChatGPT),以及为概念开发和剧本草稿撰写而专门设计的工具。例如,SHOW-1 据称可以基于已有的、经过预训练的知识产权中的角色和设定(canon)[4],创作出与之相符的叙事弧(narrative arcs),比如一集完整的电视剧集。(该产品的首个 demo 是由 AI 创作的《南方公园》剧集,如下所示。)此外,还有许多基于 ChatGPT 或 GPT-4 开发的 AI 写作助手,如 Sudowrite,它们可以提供反馈,给情节发展提出建议,以及创作与现有风格一致的文本。

Announcing our paper on Generative TV & Showrunner Agents!

— The Simulation (@fablesimulation) July 18, 2023

Create episodes of TV shows with a prompt - SHOW-1 will write, animate, direct, voice, edit for you.

We used South Park FOR RESEARCH ONLY - we won' t be releasing ability to make your own South Park episodes -not our IP! pic.twitter.com/6P2WQd8SvY

需要明确的是,我并不认为这些工具能够完全取代作家。我认为,至少在可预见的未来,吸引人的故事叙述仍需要依赖人类的判断。但这些工具可能会使写作过程变得更加高效。这与美国编剧工会(Writers Guild of America, WGA)在目前的罢工中所表达的担忧不谋而合——这种高效可能意味着减少编剧数量,或缩短编剧的工作时间。

前期制作阶段

故事板/动态分镜(Storyboarding/Animatics)

如今,我们可以使用通用的文本转图像(text-to-image)工具,比如 Midjourney 和 DALL-E,来迅速制作故事板,或者把这些图像导入 Adobe Premiere Pro,制作成初步的动态分镜(即动画化的故事板)。那些原本需要经验丰富的艺术家花费数周时间才能完成的高度风格化故事板,现在在几天内就可以完成。

Adobe 近期还透露,其将在 Premiere Pro 和 After Effects 中推出名为 Firefly 的生成式 AI 工具,其中将包括一个功能,能够仅通过上传剧本就自动生成基础故事版。

生成式 AI 视频生成工具,如 RunwayML、Pika Labs 和 Kaiber,同样能够制作动态分镜。例如,通过使用 RunwayML Gen-1,可以将特定风格应用到手机拍摄的简单视频上,从而快速制作出动态分镜(如下所示)。这意味着,编剧、剧集制作人或导演在项目推介会上可以不再只是展示文字处理的内容,而是能够展示电影的一个非常原始的版本。

可视化预演(Previs)

故事板主要用于呈现叙事风格,而可视化预演则是为了精确规划关键场景的拍摄方法,例如摄影机的放置位置、运动方式、不同元素(包括角色和道具)的空间关系,以及照明配置。可视化预演是一个成本高且劳动密集的过程,主要包括构建 3D 模型、在 3D 空间中进行布局,并为关键场景制作一个类似电影的预演片。

神经辐射场(Neural Radiance Field,NeRF)是一种较新的深度学习技术,能够根据 2D 图像近似重建 3D 场景。这使得开发 3D 模型变得更经济、更简单(特别是用于可视化预演,因为其标准比电影本身的要求低)。Luma Labs 利用 NeRF 技术能够实时从照片(甚至 iPhone 拍摄的照片)创建 3D 模型,这比制作传统 3D 模型(需要数天甚至数周的时间)要快得多。一家名为 CSM 的公司能够根据图像或视频输入创建 3D 资产。此外,Luma 以及 Spline 和 3DFY 等公司也在推出文本转 3D(text-to-3D)工具,可以根据简单的文本提示词创建 3D 模型。

无论是使用 NeRF 技术还是文本/图像/视频转 3D 技术,这些对象之后都可以导入到 Maya、Blender 或 Unreal Engine 等软件中,用于快速模拟拍摄环境。

现场制作阶段(Production)

辅助镜头(B-roll)

我已经在上面提到了 Runway、Pika 和 Kaiber,大多数人在想到“电影中的生成式 AI”时,都会想到这些文本/图像/视频转视频的生成器。亚瑟· C ·克拉克(Arthur C. Clarke)曾说过一句名言:“任何足够先进的技术都无异于魔法”。而仅通过输入提示词就能生成视频,对我来说确实有点像魔法。这些技术在短时间内已经取得了显著的进展。例如,Runway Gen-2 刚推出时,它只能根据文本提示词生成视频,用户无法预知最终结果。现在,它支持上传参考图像(例如来自 Midjourney 或 DALL-E 的图像)或视频,并提供对摄影机的自定义控制,从而更容易掌控输出。

互联网上充满了各种有趣的文本/图像/视频转视频的实验。(Runway 最近还推出了一个汇总这类内容的网站,叫做 Runway Watch,你可以在那里查看一些例子。)其中大多数是超现实的画面序列,或是虚构电影的预告片,比如这个很酷的例子。

尽管这些实验很吸引人,但它们大多仍属于新奇事物。这些内容并不是大多数人会坐在沙发上一边吃爆米花一边观看的类型。这些工具的输出是有限的(Runway 最近将视频长度从 4 秒延长到了 18 秒),而且帧间一致性很快就会变得不稳定,这严重限制了它们的实用性。此外,这些工具目前还无法同步生成对话(嘴型与音频目前无法匹配),因此在叙事方面也相对有限。

这些技术无疑会继续进步,我将在下文中进行讨论。但即使在今天,它们在传统制作中也已经能够用于制作所谓的辅助镜头(B-roll)。辅助镜头与主镜头(A-roll)交替使用,用来建立场景或氛围,展示时间的流逝,实现场景之间的过渡,或向观众提示主要角色可能错过的细节等。

文本转视频生成器在制作片头甚至预告片方面也可能很有用处。例如,迪士尼最近就使用生成式 AI 制作了《秘密入侵》的片头。另外,请看扎克·施耐德的新片《月球叛军:火之女》预告片的前 1 分钟。虽然它可能不是用生成式 AI 制作的,但看起来确实很像。

后期制作阶段(Post Production)

剪辑(Editing)

理论上讲,生成式 AI 可以极大地加快剪辑过程。它允许剪辑师仅调整一个或几个关键帧,然后由 AI 推断并将其应用到所有后续的相关帧中。

尽管 Runway 广为人知的是它的文本转视频工具,但它也提供了一整套基于 AI 的剪辑工具(如下图我的仪表板所示),其中包括清理视频背景、将任何视频转换为慢动作、仅通过文本提示词进行视频调色等功能。其中的“移除背景”工具可以自动分离视频中的特定元素,这个过程也称为动态遮罩绘制(rotoscoping),这使得该元素可以合成到一个全新的背景中。

如前所述,Adobe 最近宣布将在 Premiere 和 After Effects 中引入 Firefly。(他们已经在 Photoshop 中推出了多个 Firefly 功能,如生成式填充。)鉴于 Adobe 的产品在整个行业中被广泛使用,这一举措可能比推广像 Runway 这样的独立工具产生更深远的影响。

视觉特效(VFX)

短期而言,视效是蕴藏最大成本节约潜力的领域之一。如前所述,在大预算项目制作中,视效开支常常占到总成本的 25%,有时甚至达到 50%。尽管大部分人会将视效与超级英雄电影和科幻大片联系起来,但如今即便是中等预算的浪漫喜剧电影也可能广泛使用视效。不少明星的合同中甚至包含了使用“美容”或“数字化妆”视效的条款,用于让他们看起来更年轻,或去除皮肤瑕疵等。

对于制片公司而言,无论出于何种原因,视效都是一个政策上可操作的目标领域。大部分的视效工作都外包给了第三方公司,比如 Technicolor Creative(MPC 和 The Mill 的母公司)、维塔数码(Weta Digital)、节奏特效工作室(Rhythm and Hues)、双重否定公司(Double Negative,DNEG)、Framestore 等。当前,视效艺术家和技术人员并没有组成工会(虽然有一些人正在推动成立工会)。工业光魔(Industrial Light & Magic, ILM)是为数不多的大型内部作业公司之一,自迪士尼在 2012 年收购卢卡斯影业时便被纳入前者旗下。

传统而言,视效工作是一项极其劳动密集的工作。大部分电影的拍摄速度为每秒 24 帧,因此一部时长 2 小时的电影大约包含 173000 帧。许多视效任务需要对每个镜头中的每一帧进行操控,有时甚至需要逐像素处理,例如将 CGI 元素融合到实拍镜头中,同时还需要匹配照明、颜色和运动(包括角色的“绑定”),以及加入视效化妆(cosmetic VFX)。此外,制作看起来真实可信的流体动力学、爆炸、火焰等效果,也非常复杂且耗时。

与我之前关于剪辑的讨论类似,关键在于生成式 AI 能够自动化地完成目前需要逐帧手动完成的工作。它可以在少数参考帧中进行修改,并将这些更改传递到更多帧。例如,视效工作室 MARZ 最近推出了 VanityAI ,可以实现自动化的数字化妆、老化、减龄过程。如以下视频所示,技术人员只需指定她想要调整的区域,AI 就会在整个视频序列中进行相同的编辑。MARZ 声称其速度比传统的视效工作流快 300 倍。Perfection42 提供了一种风格转换工具,艺术家只需在少数关键帧上进行处理,然后将这种风格应用到后续帧上——这为艺术家节省了数百甚至数千小时的工作。Metaphysic 也提供自动化的减龄和换脸技术(它是“深度汤姆·克鲁斯”视频的幕后公司)。稍后将进一步介绍这方面的内容。

在传统的视效制作过程中,要让 CGI 角色融入真实的拍摄画面,通常需要由演员身穿动作捕捉(mocap)设备,并把这些设备捕捉到的动作数据映射到 CGI 角色上,确保角色动作与演员动作同步;此外,还要调整角色的颜色、质感及拍摄角度,使其与实拍镜头相匹配,最终把这个角色合成到实拍的视频片段中。而 Wonder Dynamics 则利用 AI 技术自动完成上述所有合成、照明和绑定工作,将 CGI 角色无缝融入实拍画面(如下所示)。

本地化服务(配音)(Localization Services (Dubbing))

“本地化”是指对电影或电视节目调整适配,使其面向国际市场的过程。目前,这项工作通常会外包给专门的外部供应商,比如 Deluxe 或 Iyuno,这些公司负责制作字幕,或选用当地配音演员进行配音。

尽管这项服务的成本并不算太高,但 AI 技术的应用预示着可以更加出色地完成这些任务。例如,Deepdub、MARZ(通过其产品 LipDub)和 Flawless 等公司利用 AI 技术,不仅可以将对话无缝翻译成其他语言,还能调整演员的口型,使配音看起来更加自然真实。具体可以参考 Flawless 的示例。

这一切将发展到何种程度?

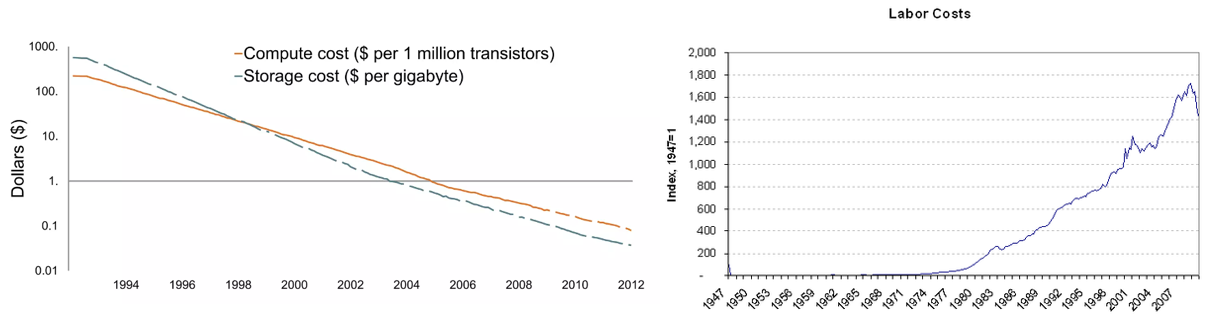

虽然这听起来似乎不言自明,但我们讨论的核心是技术如何逐渐取代人力。这种取代的广度和深度将深刻影响成本结构,因为无论是作为生成单位的函数(莱特定律 [5])还是时间的函数(摩尔定律 [6]),技术成本往往都是不断下降的,而人工成本却因生活成本上涨而不断攀升(如图 6 所示)。

那么,在影视制作领域,技术取代人力的进程会走到哪一步?限制这一进程的因素并非技术本身,而是消费者愿意接受的程度。

毫无疑问,所有这些技术工具都将持续进步,它们将会更加擅长创造越来越真实的场景、人物、服装、化妆、交通工具、动物、声音等。它们会不断优化其自动化技术,有效减轻昂贵且劳动密集的任务负担。此外,它们在创意生成方面无疑也将持续进步。

对消费者而言,“后端流程自动化”这类完全不被察觉的改进,显然是大势所趋——所有能够自动化的工作,最终都将实现自动化。但是,当这些变化直接面向消费者时,情况又会如何呢?是否存在某种消费者所能接受的“AI 含量”上限?

这里存在几种可能性。

情况 1:消费者基于某种难以预测的标准拒绝 AI

这种情况的设想是,消费者可能会因为感觉 AI 制作的内容“不够真实”或“太假”,甚至可能是出于某些个人原则,而拒绝接受 AI。就像现在食品上会有的“有机认证”或“无转基因”标签一样,可能会出现一种标签,来保证一部电影或电视剧集中有一定比例的内容是“真实”的。

但我认为,这种情况实际上很难发生。一方面,随着 AI 工具越来越多地被整合到现有的剪辑软件中(例如 Adobe 正在进行的工作),或作为插件提供,要追踪一部作品中使用了多少 AI(不论这个“多少”如何定义)会变得非常困难。

更为关键的是,自电影诞生以来,制作过程就一直在逐渐远离物理现实,而这似乎并未对观众产生负面影响。从乔治·梅里爱《月球旅行记》(1902)的定格动画,到弗里茨·朗《大都会》(1927)的精巧布景,从《金刚》(1933)的微缩模型,到《星球大战》(1977)中更为复杂的模型、服饰和化妆,从《电子世界争霸战》(1982)中首次运用的 CGI,到《侏罗纪公园》(1993)、《指环王》三部曲(2001)和《阿凡达》(2009)中不断进步的计算机图形和视效,这个过程可以画出一条清晰的发展路径。电影制作的每一步似乎都在与现实渐行渐远。正如之前提到的,如今几乎每部主流电影都运用了视效,在《阿凡达 2:水之道》这类电影中,几乎每一帧都经过了大量的数字化处理。

换句话说,人们看电影或电视的目的是为了沉浸在一个故事里并感受其中的情感,而非局限于摄影机前所发生的现实。

那么,人们会基于个人原则而拒绝 AI 吗?当消费者觉得某件事冒犯了他们的身份认同时,他们或许会从原则上拒绝某种产品(百威淡啤的经历便是一个例子),但他们通常不会出于道德理由来拒绝产品。你想过自己的 iPhone 或耐克鞋是由谁在什么条件下制造的吗?

情况 2:消费者对“生成人物”划定接受界限

我认为这个设想是有道理的。几乎从出生起,我们就对人脸的样貌及微妙的表情变化高度敏感。对那些看上去应该是人类,但又明显不符合期待的形象,我们通常会有一种强烈的反感,这就是所谓的 “恐怖谷”效应。

实际上,这意味着在许多电影和电视剧集中,我们仍然需要真人演员的参与,尽管并非所有情况都是如此。(如今,许多电影和电视剧集,尤其是科幻和漫画改编作品,并不完全依赖于真实的人脸表现,例如《阿凡达》《银河护卫队》《曼达洛人》等,其中角色的面容经常进行大幅度的数字化修改,或佩戴各种头盔。)但这同时也意味着,影视制作过程中的其它物理环节都可能被生成技术所取代。

情况 3:消费者对“生成创意”划定接受界限

在这个情况的设想下,电影或电视剧集的制作仍旧需要一个技能高度熟练的团队(或个人)来负责构思创意,并对 AI 提供的方案进行筛选。正如我之前写过的(参见此处和此处),我对这一观点持赞同态度。

然而,这同时意味着,银幕/屏幕上展示的一切都可以通过生成技术来实现。在这样的世界里,可能不再需要真人演员(自然也就不需要服装、化妆),不需要实体场景、灯光、拍摄地点、交通工具、道具等。正如 Runway 在其网站上所大胆宣称的:“无需灯光,无需摄影机,只需行动。”(“No lights. No camera. All Action.”)

情况 4:界限消失

这正对应我之前提到的 “生成式 AI 恶性循环”:

想象一个 ChatGPT-X,经过训练可以创作、评估、优化故事情节和剧本;接着,它与 Imagen Video vX 相连,生成相应的视频内容;随后,这些内容被上传到 TikTok(或其未来的替代平台),在那里,数十亿日活跃用户会测试这些内容,筛选出最具传播力的作品;这些精选内容再次被输入到 ChatGPT-X 中,进行更深入的开发。(这个令人心情沉重的设想,要感谢我那位才华横溢的前同事 Thomas Gewecke。)新的世界观、角色、电视剧集、电影乃至游戏,将无止境地被创造出来,人类的参与微乎其微。这有点像是那个著名的 无限猴子定理。

在这个设想中,影视制作成本将仅仅取决于计算成本(the cost of compute)。

未来用例预测

在考虑这些潜在情况后,我们可以展望未来可能出现的新用例。个人而言,我认为在可预见的未来,我们可能会处于情况 2 与情况 3 之间,即:大部分电影和电视剧集仍将需要人类演员的参与,至少在未来一段时间内是这样;同时,我们仍然需要由个人或小型团队来提出创意,并持续负责监督制作过程。

尽管如此,在未来几年中,制作流程仍可能发生深刻变化。以下是一份有可能发生的变化的列表,尽管不尽完全(特此感谢 Chad Nelson 对这些构想的贡献):

摄影棚/外景拍摄的终结(End of the Soundstage/End of Shooting On-Location)

如前所述,生成式 AI 已经能够在视频制作中实现快速的元素分离。随着技术的进步,其在创建、定制、合成背景与布景方面,以及灯光控制方面的能力将进一步增强。这就带来了一个问题:即使我们仍然需要演员,我们是否还需要在摄影棚或外景的受控环境下进行拍摄?或者说,是不是演员可以在一个空房间里完成表演,随后将所需的场景环境合成进去?

服装与化妆的终结(No Costumes or Make-up)

遵循相同的逻辑,随着时间的推进,通过数字技术在后期添加化妆和服装将变得越来越容易。

粗剪和视效的 AI 助手(First Pass Editing / VFX Co-Pilot)

上面的 Adobe Firefly-Premiere Pro 演示视频,向我们展示了一项引人注目的技术:在一个攀岩者的视频片段中,AI 会扫描音频,并在适当位置自动添加 B-roll 镜头。

展望未来,剪辑软件很可能首先自动完成粗剪,随后交由人类剪辑师进行审阅。我们同样可以预见到,一个 AI 剪辑或视效助手可以根据自然语言提示词来创造和微调视觉效果,比如“修正镜头其余部分的眼袋问题”。

表演替身(Acting Doubles)

随着换脸(swapping)和深度伪造(deepfake)技术的持续进步,以及如 ElevenLabs 和 HeyGen 等可以快速训练人声的合成语音工具的发展,出现了一种可能性:即一线演员(甚至是已故演员的遗产)可以将他们的形象和声音授权给电影或电视剧集,而演员本人完全不会出现在片场。

整部影片可以由一个“表演替身”完成表演,通过面部和声音替换技术,观众几乎感觉不到演员并未亲自出现。或者,主演可能只在他们“出现”的少数几个场景中亲自上阵。演员是否愿意放弃如此多的创意控制权?这还有待观察,但技术上已经成为可能。

满足电影/电视质量的文本转视频(Cinematic/TV- Quality Text-to-Video)

如前所述,文本转视频的生成器正在迅速进步,并为创作者提供更多的输出控制功能。就在几个月前,视频生成还像一台老虎机一样充满不确定性。而现在,这些工具可以在参考图像或视频上训练 AI,并且添加了更多摄影机控制功能。

基于此进行逻辑延伸,可以预见的是,视频生成的分辨率将进一步提高,对参考图像或视频的复刻将会更加精准,图像的帧间一致性将得到显著改善(如 CoDeF 和 Re-render-A-Video 所承诺的一样),输出的视频片段会更长,渲染时间会更短,且创作者能够更好地控制摄影机运动、灯光、导演风格、音频与角色的口型同步等。届时,文本转视频技术可能将不再只停留在新奇层面,而是有望组合出一部有叙事性的、值得欣赏的完整电影或电视剧集。

那么,观众是否能够接受完全没有真人参与制作的作品呢?当作品本身并不假装让观众相信自己在看真人时,观众也许是能接受的(顺便一提,这应该叫“动画”)。随着时间的推进,这个问题越来越多地转变为哲学讨论,而非单纯的审美考量。考虑到Midjourney v5 这类工具所制作的面孔越来越真实,最终人们可能难以分辨哪些是真人,哪些是生成形象。

服务于故事初稿的定制化训练模型(Custom Training Models for First Pass Storytelling)

文本/图像/视频转视频模型的另一个逻辑延伸是,它们可以基于专有的数据集进行训练。比如,迪士尼可以训练一个 AI 模型,让它学习整个漫威漫画和电影宇宙的设定,然后自动生成(近乎无限的?)新剧本和动画分镜的初稿。或者,史蒂文·斯皮尔伯格(Steven Spielberg)可以用他的所有作品训练一个模型,然后向其输入一个新的概念,看看视频生成器会输出什么内容。

这里的关键并不是说这些初稿能够直接成为值得欣赏的成品,而是这种技术能够显著提高前期开发的速度和产量。

内容的新形态(New Types of Content)

媒体发展中存在一种典型模式:新的媒介往往模仿之前的形式。早期的广播节目是歌舞杂耍表演的转播,早期的电视节目是舞台剧的电视版,而早期的网页布局则是模仿报纸或杂志的静态文本形式。但随着时间的推进,开发人员和艺术家开始挖掘新媒介的特性,用全新的方式进行故事叙述和信息传播。

我们可以思考,这对 AI 视频生成技术意味着什么。传统的电影和电视剧集是静态的成品,观众们观看的是完全相同的内容;但 Runway 这类合成视频生成器能够即时(未来甚至可能实时)创造视频。这开启了一种可定制或响应式视频内容的可能性,即视频可以根据用户输入、上下文、地理位置、当前事件而变化。这种变化意味着什么?目前还难以确切知晓——但核心观点在于,相比传统流程,AI 视频生成技术不仅可以大幅降低成本,未来还可能为观众带来一种从本质上不同的观看体验。

成本可能大幅降低

在上述的各种情况下(或许情况 1 除外),制作成本都会大幅下降。

假设创造吸引人的电影或电视节目仍然需要一支小型创意团队和真人演员。进一步假设,这个团队的成本与当前制作中的“线上”团队成本大致相当。如图 3 所示,这部分成本大约只占总成本的 20%,剩下的 80% 的成本将随着技术进步而呈现下降趋势。在当今的大预算电影中,这些“非线上”成本约为 1.6 亿至 1.7 亿美元,即每分钟正片约 150 万美元。随着时间的推移,这个数字会发生怎样的变化呢?正如之前提到的,这个答案很可能会与计算(compute)本身成本的趋势相似。想象一下,如果这个成本最终降至每分钟 1000 美元、100 美元乃至 10 美元,那会怎样?

对“线上成本保持固定”的假设可能过于乐观了,因为成本的降低很可能从根本上改变影视制作的经济模式。如前所述,当前的电影和电视剧集制作不仅成本高昂,而且风险巨大。鉴于制片公司需要承担这些风险,它们通常会保留项目的几乎全部所有权(equity)。与之相对的是,它们向一线明星支付高额固定报酬,而只在某些情况下才不情愿(且吝啬)地给剧组其他成员一些利润分成。“线上”成本本质上就是这些有保证的固定报酬。

然而,如果“非线上”成本不再是数千万或数亿,而是降至数百万甚至数千美元呢?这样一来,制片公司就无需承担如此巨大的风险。在这种新的经济模式下,创意团队可能会选择放弃(来自制片公司的)固定报酬,而是自行融资制作,并自主保留项目的大部分所有权(equity)和潜在收益(upside)——换言之,我们今天所熟悉的线上成本可能会消失。如果线上成本实质上已经消失,那么即便仍然有大量人力参与,制作电影或电视剧集的前期成本最终也可能会下降几个数量级。

好莱坞应该做什么?

我最近发表的许多文章(《电视启示录的四骑士》 《告别电视黄金时代,迎接无限电视的时代》)《好莱坞的颠覆进程将如何展开?》)都基于一个共同前提,那就是制作成本的下降将会降低进入影视行业的门槛。如前所述,随着时间的推移,小团队和个体创作者将能够以极低的成本生产出与好莱坞水准相媲美的内容,我称之为“无限内容”(“infinite content”)现象。尽管好莱坞目前仍在应对由 Netflix 15 年前引发的内容发行方式的巨大变革,但这种门槛的降低有可能触发行业的下一波颠覆性改变。

对好莱坞而言,积极的一面在于,这些新技术同样能够帮助他们降低成本。那么,如果你是大型制片公司的负责人,该如何利用这一优势?要考虑的是,你管理的是一家已经习惯于固定作业模式的庞大企业,同时还要与其他公司争夺创意人才,并且通常情况下(作为公司)并没有足够的议价能力来对制作流程进行干涉,当面对行业内最热门的顶级人才时更是如此。(“是的,克里斯·诺兰,我们很欣赏你的最新项目,但我们需要对你的创作流程进行一些基本的调整……”)。

采用这些新技术所带来的挑战不仅存在于技术层面,更存在于应变管理(change management)层面。让人们改变固有习惯真的很难,我明白这一点。这正是小型独立团队能够更快速地采纳这些工具的原因——它们没有历史包袱,可以自由尝试。

对于成熟的制片厂来说,有两种策略可以选择:

选择非核心流程进行尝试。 最具政策可行性的流程将是那些已经由第三方完成的流程。例如,可以将本地化服务转移给市场上一些支持 AI 的服务提供商,或者可以要求内部团队更多地采用 AI 工具来承担视效工作,从而降低成本。

成立秘密研发部门(Skunkworks)。可以成立一个独立的工作室,从零开始探索“AI 优先”内容制作方式的相对成本、质量和效率。

这些逐步推进的策略在短期内可能不会立竿见影,但它们至少能够帮助企业开始适应 AI 技术,建立起使用 AI 的“肌肉记忆”。

我知道,这一切令人目不暇接

确实,所有这一切都在以一种令人眼花缭乱的速度发展着。即便是像我这样花费大量时间试图掌握新进展的人,也难以跟上这种速度。对于从业者而言,这既是一次激动人心的冒险,也可能是一场令人不知所措甚至心生恐惧的挑战。

技术的脚步不会停歇,无论这对我们来说是好是坏。但是,知晓即是准备,准备即是力量。

(完)

- 1.原文为 skunkworks studios。Skunk Works 直译为“臭鼬工厂”,是洛克希德·马丁公司在二战期间建立的高级开发项目的绰号,因当时其厂址毗邻一家散发着恶臭的塑料厂,员工不得不着民防用防毒面具来上班。这个词现在广泛用于描述任何类似的秘密研发团队或项目,其特点是小型、灵活、高度自主、远离主流业务流程,能够不受常规程序和官僚主义的约束,专注于快速创新和开发新技术或产品。 ↩

- 2.制片人和制片公司通常发掘现有的文学素材并将其拍成电影、电视剧集或者多媒体产品,比如已经创作完成的故事梗概、剧本、舞台剧、杂志上的文章、书籍或电视游戏。在大多数情况下,比起花重金一次性彻底买断版权(literary property),他们更愿意购买作品的“优先购买权”(option),后者相对前者而言更加省钱。在这里,“优先购买权”指的是以规定的价格购买版权或者版权中的某一项专门的权利(比如拍成电影、电视或者是在网络传播)的短期使用权,这种权利具有排他性和不可撤销性。这样在权利人享有“优先购买权”期间,其他人就不能获取这个已经被制片人预定的作品。因此,这项权利就使得制片公司或制片人在一定期限内控制了该部作品,利用它着手对作品开展商业活动、挖掘市场价值,而不必花费全价“买断”这部作品的版权。这样,就能减少制片公司或制片人在影视制作前的风险,而且比购买全部作品版权的情况能开发出更多的项目。 ↩

- 3.开发地狱(development hell),指的是一部电影、电子游戏、专辑、电视节目、剧本、软件长期停留在概念阶段,难以进入到制作阶段。有些陷入制作困境的项目不会被正式取消,它直到工作进度达到令人满意的状态才会正式进入制作阶段。 ↩

- 4.在文学、艺术、电影、电视剧集以及其他形式的创作领域中,Canon 被用来指代一系列被认为是某个虚构宇宙、系列或作者作品集中正式认可、官方承认的故事、角色、设定和事件。这通常包括原创作品中明确呈现的内容,以及后续官方扩展(如续集、前传、官方小说、漫画等)中的元素。Canon 确定了哪些故事是“正史”,哪些属于非正式或“非官方”的,有助于维护故事的连贯性和完整性。例如,在电影和电视剧集中,Canon 用于区分哪些情节和角色是官方故事线的一部分,哪些可能只是粉丝创作或非官方作品的一部分。这对于理解角色发展、故事走向以及整个宇宙的规则至关重要。 ↩

- 5.莱特定律(Wright's Law):生产单位数量每增加一倍,成本就会以固定百分比下降(最常见的是下降10-20%)。 ↩

- 6.摩尔定律(Moore's Law):集成电路中晶体管的单位数量每18个月翻一番。 ↩

转载请注明来源。欢迎留言评论,欢迎对文章中的引用来源进行考证,欢迎指出任何有错误或不够清晰的表达。